| Главная » Статьи » Интересно |

|

“Нам грозит не пришествие сверхразумных машин, а появление неполноценно мыслящих человеческих существ” Хьюберт Дрейфус В настоящем сообщении я сделал краткий обзор истории разработки искусственного интеллекта (ИИ) и привел различные, зачастую противоположные, оценки авторитетных экспертов о возможности достижения сильного ИИ. Меня особенно интересовал круг проблем, главным образом философских, которые предстоит решить на этом пути. Анализ доступной информации позволил мне прийти к выводу о том, что, хотя достижение сильного ИИ теоретически возможно, но сложность задач, которые предстоит решить, а также отсутствие реальной практической заинтересованности у мировых элит, делает достижение именно сильного ИИ крайне маловероятным событием на горизонте планирования в 10-20 лет.

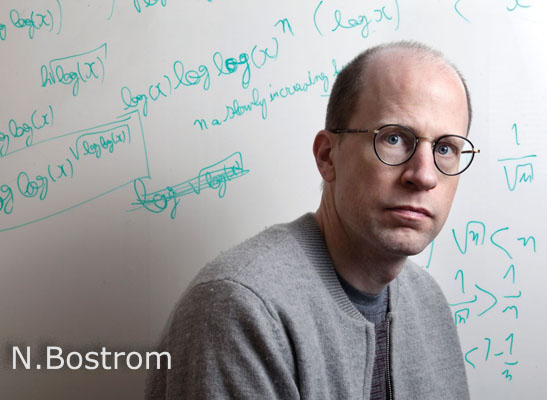

Материал получился достаточно объёмным. Я не стал разбивать его на части, а постарался убрать под каты специальную информацию и обширные цитаты, которые можно пропустить при общем ознакомлении с темой. Литература, которую я использовал, приведена в конце материала общим списком. Обсуждая тему ИИ, очень важно договориться о терминах. Иначе легко получить подмену понятий. Ранее я уже приводил эти определения, которые сформулировал Tim Urban (The AI Revolution: The Road to Superintelligence ) со ссылкой на авторитетных экспертов: 1. Узкий ИИ - Artificial Narrow Intelligence (ANI): Это ИИ специализирующийся на конкретной задаче/проблеме. И, зачастую, превосходящий человека в решении этой задачи. Например, шахматная программа обыграла человека, но она умеет только это. Речь идёт о различного рода экспертных системах, как правило, работающих с большими объёмами данных. 2. Общий ИИ - Artificial General Intelligence (AGI): Его ещё называют ИИ человеческого уровня (например, Универсальный Человекоподобный Интеллект – УЧИ). Так называют ИИ, который сравнялся с человеком в решении любых интеллектуальных и творческих задач. Профессор Линда Готтфредсон ( Linda Gottfredson) описывает такой ИИ как “предельно общую ментальную способность, которая, среди прочего, включает умение размышлять, планировать, решать задачи, думать абстрактно, постигать сложные идеи, быстро обучаться, а также учиться на собственном опыте”. УЧИ смог бы делать всё это также легко, как и человек. 3. Супер ИИ Artificial Superintelligence (ASI): По определению Ника Бострома (Nick Bostrom), эксперта в области ИИ из Оксфорда, это “интеллект, который намного превосходит наилучшие человеческие мозги в практически любой области, включая научное творчество, жизненную мудрость и социальные навыки.”

До некоторого времени эти определения меня устраивали. Однако, хотя такого рода определения достаточно распространены, их практическое использование порождает массу вопросов. Более того, эти определения уводят в сторону от понимания сущности сильного ИИ и тех проблем, которые неизбежно возникнут на пути к его достижению. Обсуждение начну с прояснения терминологической путаницы: слабый - узкий, сильный - общий. Если между слабым и узким ИИ никто особых различий не делает (это решение, заточенное на специальную задачу), то в отношении сильного-общего ИИ есть эксперты, которые пытаются различать эти понятия (например, Рагнар Фьёлланд, на недавнюю статью которого «Почему общий ИИ не будет реализован» в Nature я буду далее ссылаться). Дескать, поскольку человеческий интеллект носит общий, универсальный характер (подразумевается, способен решать самые разные задачи), то и искусственный интеллект, который может то же самое, должен называться общим. А вот интеллект идентичный человеческому должен называться сильным. В приведённых выше определениях разница между слабым и общим ИИ достаточно условна, и она, скорее, количественная, чем качественная. Системы экспертного уровня уже сейчас способны и «решать задачи», и «быстро обучаться» (в том числе на собственном опыте), и «планировать», и «постигать сложные идеи», а также писать музыку, стихи, рисовать и т.п. И многие конкретные задачи слабые ИИ уже делают «также легко», а порою и гораздо лучше и быстрее, чем человек. Так что, при таком подходе можно говорить о проблеме объединении различных специализированных (слабых) ИИ в один универсальный. О качественных различиях между слабым и общим ИИ, вроде бы, речь не идёт. Остаётся лишь уточнить, кому и зачем нужен робот-шахматист, который ещё и поёт, рисует, предсказывает погоду и находит собак на фотографиях. Другими словами, задача собрать из разнородных «экспертов» одного «суперэксперта» – это проблема, скорее, целесообразности, чем научного вызова. Могут возразить (хотя из приведённых выше определений это прямо не следует), что под «общим» понимается ИИ, обладающий таким запасом «интеллекта» (что бы это понятие ни значило), который позволяет ему, при необходимости, самостоятельно осваивать любые новые навыки и профессии, подобно тому как это делает человек. И делать это не хуже человека. Такое уточнение существенно, оно, однако, не снимает всех вопросов. А вопросы возникают следующие: должен ли такой УЧИ обладать качествами, на первый взгляд, не связанными напрямую с решением задач, но присущими человеку? Такими как мораль, эмоции, вера, целеполагание, саморазвитие и т.п. Эти, и многие другие, качества являются неотъемлемыми атрибутами человеческого сознания. Нужно ли моделировать и их при создании УЧИ?

Приведённое выше определение ИИ, фактически, не различает задачи «научиться делать как человек (или лучше)» и «научиться быть человеком (или лучше)». А разница здесь принципиальна. Это понимание нашло отражение в формулировке, которую дают в своей знаменитой книге С.Рассел и П.Норвиг: “утверждение, что машины, возможно, способны действовать так, как будто действительно являются интеллектуальными, философы называют гипотезой слабого искусственного интеллекта, а утверждение, что машины действительно мыслят (а не просто имитируют мыслительные процессы), называется гипотезой сильного искусственного интеллекта». При таком подходе осталось определить, как именно люди «действительно мыслят». Наконец, вряд ли стоит содержательно различать понятия сильного и супер ИИ, так как многие разделяют точку зрения, что путь от сильного к супер ИИ будет очень коротким: сильный ИИ, работая над собственным совершенствованием достаточно быстро разовьёт навыки, которыми мы наделили супер ИИ. Далее я буду говорить исключительно о так определённом сильном ИИ, игнорируя двусмысленное понятие УЧИ (AGI). Рассматривать проблему я предлагаю в двух аспектах: теоретическом (можно ли и каким образом создать сильный ИИ в идеальных условиях?) и конкретно-практическом (возможно ли реализовать теоретическую программу на практике?) ИИ: долгая дорога к силеПраотцом ИИ смело можно назвать Алана Тьюринга. Многие из вопросов о сильном ИИ, задолго до появления самого понятия, он поставил и рассмотрел в своей статье 1950г. Её можно найти в книге «Может ли машина мыслить?», изданной в 1960 (это русский перевод двух статей, А.Тьюринга и Дж.Неймана 1950 и 1951гг.). Именно Тьюринг сделал всё для обоснования «функционалистского» подхода к разработке ИИ, то есть ц Реализуя такой подход к проблеме, Тьюринг предложил отвечать на вопрос «Может ли машина мыслить?» по результатам некоей «игры в имитацию», которая теперь (в некоторой адаптированной форме) известна как Тест Тьюринга. Он так описал свой подход: «…вопрос «могут ли машины мыслить?» можно заменить вопросом «существуют ли воображаемые цифровые вычислительные машины, которые могли бы хорошо играть в имитацию?». Сам Тьюринг считал возможным прохождение такого теста с ростом вычислительной мощности машин:

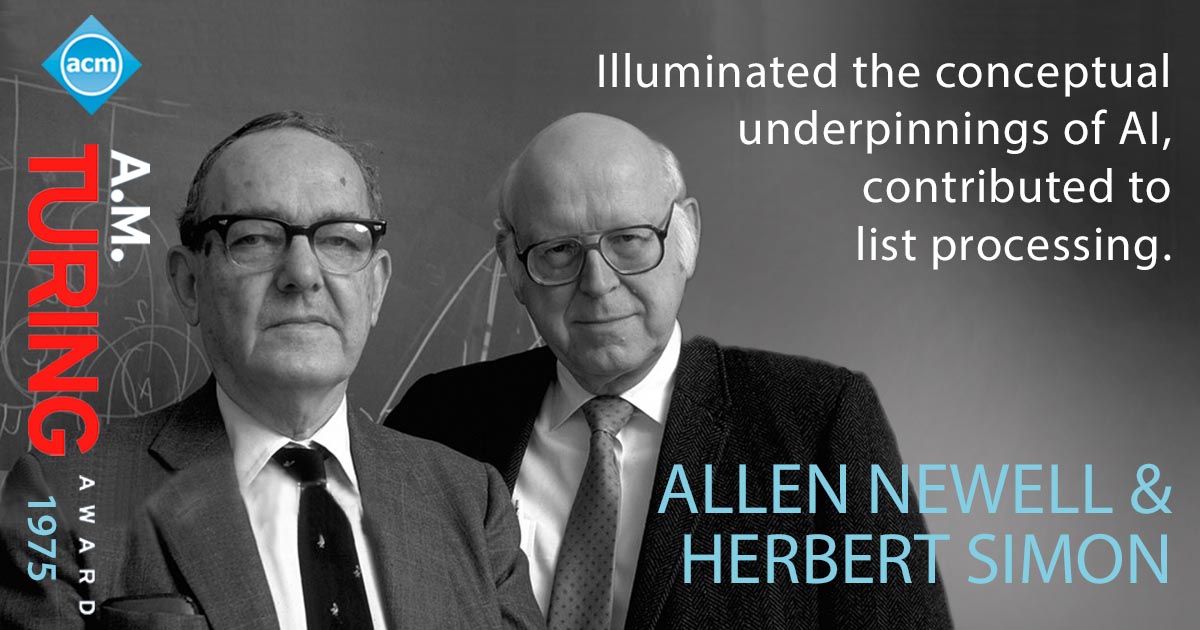

За 70 лет, прошедших со времени предложенного теста, проходить его (с разным успехом) пытались многократно и к нему накопилась масса вопросов. Большинство экспертов считает, что удача/неудача в прохождении теста не даёт однозначного ответа на поставленный вопрос о способности машины мыслить. Фактически, предложив тест-имитацию и отказавшись всерьёз обсуждать вопрос о способности машин "действительно" мыслить, Тьюринг определил программу исследований в области ИИ на многие годы вперед. Это программа так называемого «символического ИИ», который предельно упрощённо можно определить как попытку свести любую мыслительную деятельность к следованию набору эвристических правил и алгоритмам, оперирующим, в конечном итоге, символами. Как писали отцы-основатели ИИ Саймон (Simon H.A.) и Ньюэлл (Newel A.): «Физическая символьная система имеет необходимые и достаточные средства для произведения основных интеллектуальных операций». Сам Тьюринг в своей статье попытался предвосхитить возможные возражения к своему подходу и заранее ответить на них. Он привел целых 9 гипотетических возражений:

«Мышление есть свойство бессмертной души человека. Бог дал бессмертную душу каждому мужчине и каждой женщине, но не дал души никакому другому животному или машинам. Следовательно, ни животное, ни машина не могут мыслить».

«Последствия машинного мышления были бы слишком ужасны. Будем надеяться и верить, что машины не могут мыслить»

Имеется ряд результатов математической логики, которые можно использовать для того, чтобы показать наличие определенных ограничений возможностей машин с дискретными состояниями. Наиболее известный из этих результатов — теорема Гёделя — показывает, что в любой достаточно мощной логической системе можно сформулировать такие утверждения, которые внутри этой системы нельзя ни доказать, ни опровергнуть, если только сама система непротиворечива

Дж.Джефферсон: «До тех пор, пока машина не сможет написать сонет или сочинить музыкальное произведение, побуждаемая к тому собственными мыслями и эмоциями, а не за счет случайного совпадения символов, мы не можем согласиться с тем, что она равносильна мозгу, т. е. что она может не только написать эти вещи, но и понять то, что ею написано».

«Я согласен с тем, что вы можете заставить машины делать все, о чем Вы упоминали, но Вам никогда не удастся заставить их делать X». При этом перечисляют довольно длинный список значений этого X

«Аналитическая машина не претендует на то, чтобы создавать что-то действительно новое. Машина может выполнить все то, что мы умеем ей предписать» (курсив леди Лавлейс).

Нет сомнения в том, что нервная система не является машиной с дискретными состояниями. Небольшая ошибка в информации относительно силы нервного импульса, действующего на нейрон, может привести к значительному изменению импульса на выходе. Исходя из этого, можно было бы как будто предполагать, что нельзя имитировать поведение нервной системы с помощью машины с дискретными состояниями.

«Если бы каждый человек обладал определенной совокупностью правил действия, следуя которым он живет, он был бы не чем иным, как машиной. Однако таких правил не существует. Следовательно, человек не может быть машиной».

Возражение с точки зрения сверхчувственного восприятия, по моему мнению, является достаточно серьезным. На него можно было бы возразить, сказав, что многие научные теории, несмотря на весь шум вокруг сверхчувственного восприятия, остаются применимыми на практике, так что в действительности можно прекрасно обойтись и без него, попросту забыв о его существовании. Это, пожалуй, слабое утешение; есть опасение, что мышление относится как раз к одному из тех явлений, к которым сверхчувственное восприятие имеет, быть может, непосредственное отношение.

Следует отметить, что не все приведённые возражения интересны и актуальны сейчас. К тому же, Тьюринг оказался гораздо лучшим криптографом, чем полемистом. На мой взгляд, большинство возражений ему не удалось убедительно парировать, обосновав, тем самым, свою позицию. Да он и сам это признавал, написав в свой статье:

Тем не менее, три возражения не только не потеряли актуальность, но и, на мой взгляд, принципиально важны для ответа на вопрос о достижимости сильного ИИ. Это – теологическое возражение, возражение с точки зрения сознания и возражение с точки зрения сверхчувственного восприятия, так как они затрагивают саму природу человека, а не только способ организации его мышления. К их рассмотрению я предполагаю вернуться в ходе дальнейшего изложения. Это время (50-е и 60-е годы прошлого века) сопровождалось бурным интересом к проблеме ИИ, от которого ожидали быстрого прогресса именно в создании ИИ, который сейчас мы именуем сильным ИИ. Вот лишь некоторые авансы, которые выдавались тогда под хорошее финансирование: 1958, Саймон, один из авторов программы GPS (General Problem solver, успешно решавший алгоритмические задачи):

1965, Саймон

1967, Марвин Мински

1970, Марвин Мински

Авансы не оправдались. Началась «зима» искусственного интеллекта. В итоге, правительства США и Британии начали урезать финансирование исследований ИИ для университетов. DARPA, без проблем финансировавшее исследования ИИ в 1960-х, стало требовать от проектов чётких временных рамок и подробного описания предполагаемых результатов. В итоге стало казаться, что ИИ не оправдал ожиданий, и никогда уже не сможет достичь уровня человеческих возможностей. Одной из причин было несоответствие вычислительной мощности машин сложности большинства задач ИИ. Это назвали «проклятием размерности» (вариант – «комбинаторный взрыв»), когда уже для простейших задач с 30 логическими правилами (параметрами алгоритма) полный перебор всех вариантов даже с эвристиками и прочими сокращениями перебора (на «деревьях решений») занимал многие часы и даже годы вычислений. Первая «зима» ИИ продлилась все 1970-е. Некоторое оживление случилось в начале 80-х, с началом разработки и первыми успехами экспертных систем, работавших с большими объёмами данных и имитировавшими процесс принятия решений людьми. Экспертные системы были призваны заменить специалистов-экспертов при разрешении проблемных ситуаций. Они представляли собой автоматизированные компьютерные системы, реализующие программы на основе набора правил, позволяющих распознавать ситуации и делать простые логические умозаключения. Выводились эти умозаключения из баз знаний, составленных специалистами в соответствующих предметных областях и переведенных на формальный машинный язык. Успех экспертных систем вдохновил DARPA на увеличение финансирования исследований ИИ, но вскоре агентство урезало большую часть этого финансирования, оставив всего несколько программ. Частные инвесторы старались держаться на почтительном расстоянии от любых начинаний, имевших малейшее отношение к проблеме искусственного интеллекта. Даже в среде ученых и финансировавших их организаций сам этот термин стал нежелательным. Вторая «зима» ИИ продлилась до конца 90-х.

В центр общественного внимания ИИ вернулся в 1997 году, когда шахматный компьютер Deep Blue от IBM победил тогдашнего чемпиона мира Гарри Каспарова. У компьютера Deep Blue было достаточно вычислительных мощностей, и он использовал «метод грубой силы», или полный перебор, оценивая 200 млн возможных ходов в секунду и подбирая наилучший. Работа Deep Blue была похожа на работу ИИ, но компьютер не размышлял о стратегиях и не учился игре, как смогут это делать последовавшие за ним системы.

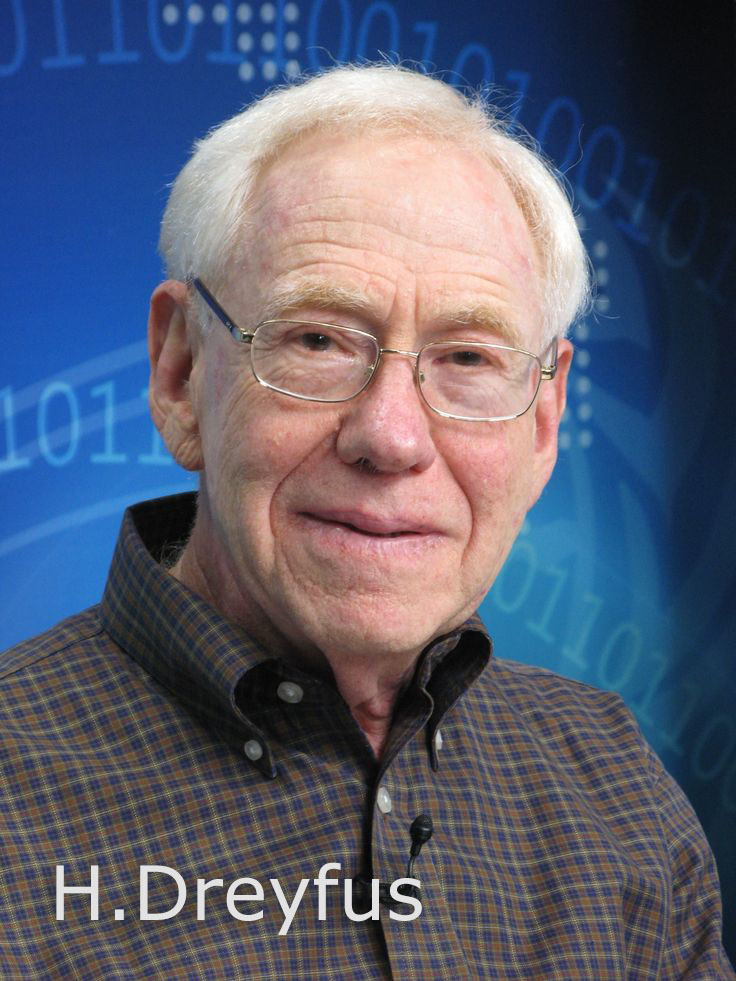

Можно считать, что все это время (вплоть до начала 2000-х) исследования велись в парадигме, получившей известность как «добрый старый искусственный интеллект», или сокращенно GOFAI (Good Old Fashioned AI); этот термин в 1985 году предложил Джон Хогланд (John Haugeland). В основе GOFAI лежит утверждение, будто все интеллектуальное поведение может быть представлено с помощью системы, которая формирует логические рассуждения на основании множества фактов и правил, описывающих рассматриваемую проблемную область. Одними из первых, кто обоснованно сомневался в успехе такого подхода, был философ Хьюберт Дрейфус, который написал ряд влиятельных критических статей против искусственного интеллекта, в том числе с братом Стюартом. В обстановке всеобщей эйфории, Дрейфус писал, что оптимистичные предсказания апологетов ИИ никогда не сбудутся, и указал на явные и неявные допущения теории ИИ, раскритиковав их.

Дрейфус отстаивал феноменологический подход к сознанию, согласно которому, человек обладает периферийным сознанием, позволяющим ему выхватывать из мира сигналы в фоновом режиме. И хотя таких сигналов может быть неопределенно много, человек оказывается защищен от комбинаторного взрыва, когда решение задачи многократно усложняется с каждым следующим шагом доказательства. Далее, человек может различать релевантное и нерелевантное на основе глубокого понимания ситуаций, инсайта. Программы же различают важное и неважное согласно правилам, составленным их авторами. Кроме того, люди чувствительны к контексту и обладают терпимостью к неоднозначности. Они могут понять двусмысленное предложение, они воспринимают оптические иллюзии (вроде куба Неккера). Большинство знаний, которые мы применяем в нашей повседневной жизни неявны. Их трудно объяснить и формализовать, тем более в виде алгоритмов. Если, подобно сороконожке из известной притчи, мы станем задумываться перед каждым шагом как правильно поставить ногу, то просто не сможем ходить. По выражению Майкла Полани, «… мы можем знать больше, чем можем сказать». В 1980-х, после первой зимы ИИ, от «символического» ИИ перешли к моделированию процессов в человеческом мозге. Появились первые искусственный нейронные сети, которые могли обучаться. Адепты ИИ (в частности, Рассел и Норвиг) отмечали, что возражения Дрейфуса касались GOFAI, который соответствует простейшему логическому агенту, и Дрейфус был прав, утверждая, что логические агенты действительно имеют слабое место, поскольку не позволяют решить проблему спецификации. Однако, получившие всё большее распространение новые подхода в разработке систем ИИ, связанные с машинным обучением и нейросетями, вроде бы, открывали дорогу к решению этой и других трудных проблем. Сам Дрейфус и его брат считали, что принципиально ничего не изменилось, указывая на ограниченность нейронных сетей. Рассел и Норвиг в своей книге вступили в полемику с Дрейфусами и ответили на их замечания: 1. Качественное обобщение на основании примеров не может быть достигнуто без фоновых знаний. Дрейфусы утверждают, что не существует способа, позволяющего использовать фоновые знания в процессе обучения нейронной сети. - А в действительности уже разработаны такие методы, которые позволяют использовать априорные знания в алгоритмах обучения. Тем не менее эти методы основаны на том, что в наличии имеются знания, представленные в явной форме, а этот подход братья Дрейфус упорно отрицают. По мнению авторов настоящей книги, взгляды этих ученых являются основательной причиной для серьезного перепроектирования современных моделей нейронной обработки информации, для того чтобы в них можно было воспользоваться знаниями, полученными ранее в процессе обучения, по такому же принципу, как такие знания используются в других алгоритмах обучения. 2. Обучение нейронной сети представляет собой одну из разновидностей контролируемого обучения, для которой требуется заблаговременное выявление релевантных входных данных и правильных выходных данных. Поэтому, по утверждению братьев Дрейфус, система обучения нейронной сети не может действовать автономно, без помощи учителя человека. - В действительности обучение без учителя может осуществляться с помощью методов неконтролируемого обучения и обучения с подкреплением. 3. Производительность алгоритмов обучения снижается при использовании большого количества характеристик, а если выбрано лишь подмножество характеристик, то, по словам этих ученых, ‘‘не существует способа введения новых характеристик в том случае, если будет обнаружено, что текущее множество не позволяет учитывать некоторые факты, усваиваемые в процессе обучения’’. - В действительности с большими множествами характеристик очень успешно справляются такие новые методы, как машины поддерживающих векторов. Существует также принципиальная возможность вырабатывать новые характеристики, хотя для этого требуется гораздо больше усилий. 4. Мозг способен направлять свои сенсоры на поиск релевантной информации и обрабатывать ее для извлечения аспектов, релевантных для текущей ситуации. Дрейфусы утверждают, что ‘‘в настоящее время неизвестны детали этого механизма и нет даже таких гипотез о его работе, которые направили бы исследования искусственного интеллекта по правильному пути’’.

Из приведённой полемики можно сделать вывод о том, что критики ИИ указывают на всё новые особенности взаимодействия нашего сознания с миром, извлечения и обработки знаний, построения умозаключений, обучения новым навыкам и т.п., которые неподвластны существующим моделям ИИ. И всякий раз адепты ИИ указывают на возможные способы (иногда чисто гипотетические) обойти эти ограничения, улучшая архитектуру ИИ. У подхода Дрейфуса есть и сторонники. Так, на правоте Дрейфуса настаивает Рагнар Фьёлланд, на недавнюю статью которого «Почему общий ИИ не будет реализован» в Nature я буду далее ссылаться.

Создание сильного ИИ – теоретические аспектыЕсли кратко, то всего есть два пути развития ИИ: первый – создать идеальный инструмент для расширения возможностей человека в решении стоящих перед ним проблем, в освоении (покорении?) земных и внеземных пределов, второй – сделать upgrade самого человека, создав некоторого суперчеловека, который наследует Землю и сам будет определять цели и смыслы. Для реализации этой программы существуют три основных стратегии, о которых, например, подробно пишет в своей книге эксперт в области ИИ, футуролог Ник Бостром. 1.Инструментальный ИИПодход, использующий функциональность мозга в качестве отправной точки, но разработка низкоуровневого моделирования не планируется. Поскольку набор базовых механизмов функционирования мозга весьма ограничен — на самом деле их очень небольшое количество (см. выступление доктора Курпатова на AI Journey-2019, в котором известные механизмы перечислены), — все эти механизмы рано или поздно будут изучены благодаря постоянным успехам нейробиологии. Однако, уже сегодня можно распознать некоторые обязательные характеристики, присущие подобной интеллектуальной системе. Совершенно очевидно, что способность к обучению как неотъемлемое свойство ядра системы должна закладываться при проектировании, а не добавляться в качестве запоздалого соображения позднее в виде расширения. То же самое касается способности эффективно работать с неопределенной и вероятностной информациями. Скорее всего, среди основных модулей современного ИИ должны быть средства извлечения полезной информации из данных от внешних и внутренних датчиков и преобразования полученных концепций в гибкие комбинаторные представления для дальнейшего использования в мыслительных процессах, основанных на логике и интуиции. 2.Полная эмуляция головного мозга человекаВ процессе полномасштабного имитационного моделирования головного мозга, который называется «полная эмуляция мозга» или «загрузка разума», искусственный интеллект создается путем сканирования и точного воспроизведения вычислительной структуры биологического мозга. Таким образом, приходится всецело черпать вдохновение у природы. Прежде всего нужно, имея в наличии необходимое оборудование и соблюдая все условия, провести три главные манипуляции: 1) сканирование — высокопроизводительные микроскопы с хорошим разрешением, дающие возможность обнаружить нужные свойства; 2) трансляция — автоматизированный анализ изображений для перевода исходных данных сканирования в связанную трехмерную модель из релевантных вычислительных элементов; 3) моделирование — компьютер, достаточно мощный для обработки полученной оцифрованной структуры. 3.Усовершенствование когнитивных способностей самого человекаТретий путь создания интеллекта, превосходящего человеческий, это улучшение функционирования биологического мозга, повышение когнитивных способностей человека. Периодически выдвигаются предложения использовать прямой нейрокомпьютерный интерфейс, в частности, имплантаты, что позволит человеку использовать всю мощь электронных вычислений: идеальное хранение информации, быстрые и точные арифметические расчеты, широкополосную передачу данных — в результате такая гибридная система будет принципиально превосходить по всем характеристикам деятельность головного мозга. Возможность прямого подключения компьютера к биологическому мозгу была не раз доказана, но, несмотря на это, кажется маловероятным, что прямые нейронные интерфейсы получат в обозримом будущем широкое распространение. В принципе, этого можно было бы достичь без применения технологий, а за счет селекции. Однако любая попытка запустить классическую программу евгеники столкнется и с политическими, и этическими препятствиями. Кроме того, для получения сколько-нибудь значимых результатов — если только отбор не будет чрезмерно строгим — потребуется множество поколений. Задолго до того как такая программа принесет плоды, человечество в результате развития биотехнологий получит прямой контроль над генетикой и нейробиологией, что сделает ненужными проекты по селекции людей. Многообещающей технологией на сегодняшний день кажется итеративная селекция эмбрионов. Однако, в сравнении с возможными прорывами в искусственном интеллекте биологические улучшения будут происходить относительно медленно и постепенно. Следует обратить, что в пп.2-3, в силу выбранного подхода, речь идёт о создании улучшенной копии человека со всеми его атрибутами (мышление, сознание, чувства, эмоции) либо путём копирования в лаборатории результата, который получился у природы в ходе длительной эволюции, либо путём евгеники, т.е. апгрейда этого самого результата (человека). В то время как в п.1 речь идёт, скорее, об имитации (в стиле Тьюринга) «в железе» функциональных возможностей человека и последующем их улучшении. Будет ли получившийся киборг ещё и чувствовать, обладать сознанием, вопрос при таком подходе не принципиальный и не сильно волнует исследователей. Тот же Шмидхубер считает, что всё это можно запрограммировать в виде дополнительного бонуса. Источник: https://aftershock.news/?q=node/925274 | |

| Просмотров: 834 | Теги: | Рейтинг: 3.0/1 |

| Всего комментариев: 0 | |

| Смешное [4] |

| Интересно [19] |

| Книги загрузить [12] |

елесообразности ставить и решать именно задачу «научиться делать как человек». Суть функционализма выражает известная поговорка – не важно, какого цвета кошка, лишь бы она ловила мышей. Т.е не важно, может ли машина на самом деле по-человечески мыслить, понимать, сознавать, чувствовать и т.п., если она умеет с помощью алгоритмов и программ решать, предсказывать, вычислять, а также имитировать понимание, сознание, чувства и т.п. Приверженцы таких идей (например, тот же

елесообразности ставить и решать именно задачу «научиться делать как человек». Суть функционализма выражает известная поговорка – не важно, какого цвета кошка, лишь бы она ловила мышей. Т.е не важно, может ли машина на самом деле по-человечески мыслить, понимать, сознавать, чувствовать и т.п., если она умеет с помощью алгоритмов и программ решать, предсказывать, вычислять, а также имитировать понимание, сознание, чувства и т.п. Приверженцы таких идей (например, тот же